2.1.1

Γραμμική Παλινδρόμηση

Σύνοψη

- Η γραμμική παλινδρόμηση μοντελοποιεί τη γραμμική σχέση μεταξύ εισόδων και εξόδων και παρέχει μια βάση αναφοράς που είναι τόσο προβλεπτική όσο και ερμηνεύσιμη.

- Η μέθοδος ελαχίστων τετραγώνων εκτιμά τους συντελεστές ελαχιστοποιώντας το άθροισμα των τετραγωνικών υπολοίπων, δίνοντας μια λύση κλειστής μορφής.

- Η κλίση μας λέει πόσο αλλάζει η έξοδος όταν η είσοδος αυξάνεται κατά μία μονάδα, ενώ η τεταγμένη στην αρχή αντιπροσωπεύει την αναμενόμενη τιμή όταν η είσοδος είναι μηδέν.

- Όταν ο θόρυβος ή οι ακραίες τιμές είναι μεγάλες, εξετάστε την τυποποίηση και τις ανθεκτικές παραλλαγές, ώστε η προεπεξεργασία και η αξιολόγηση να παραμένουν αξιόπιστες.

Εισαγωγή #

Αυτή η μέθοδος πρέπει να ερμηνεύεται μέσα από τις υποθέσεις της, τις συνθήκες των δεδομένων και τον τρόπο με τον οποίο οι επιλογές παραμέτρων επηρεάζουν τη γενίκευση.

Αναλυτική Επεξήγηση #

Μαθηματική Διατύπωση #

Ένα μονομεταβλητό γραμμικό μοντέλο γράφεται ως

$$ y = w x + b. $$Ελαχιστοποιώντας το άθροισμα των τετραγωνικών υπολοίπων \(\epsilon_i = y_i - (w x_i + b)\)

$$ L(w, b) = \sum_{i=1}^{n} \big(y_i - (w x_i + b)\big)^2, $$λαμβάνουμε την αναλυτική λύση

$$ w = \frac{\sum_{i=1}^{n} (x_i - \bar{x})(y_i - \bar{y})}{\sum_{i=1}^{n} (x_i - \bar{x})^2}, \qquad b = \bar{y} - w \bar{x}, $$όπου \(\bar{x}\) και \(\bar{y}\) είναι οι μέσοι όροι των \(x\) και \(y\). Η ίδια ιδέα επεκτείνεται στην πολυμεταβλητή παλινδρόμηση με διανύσματα και πίνακες.

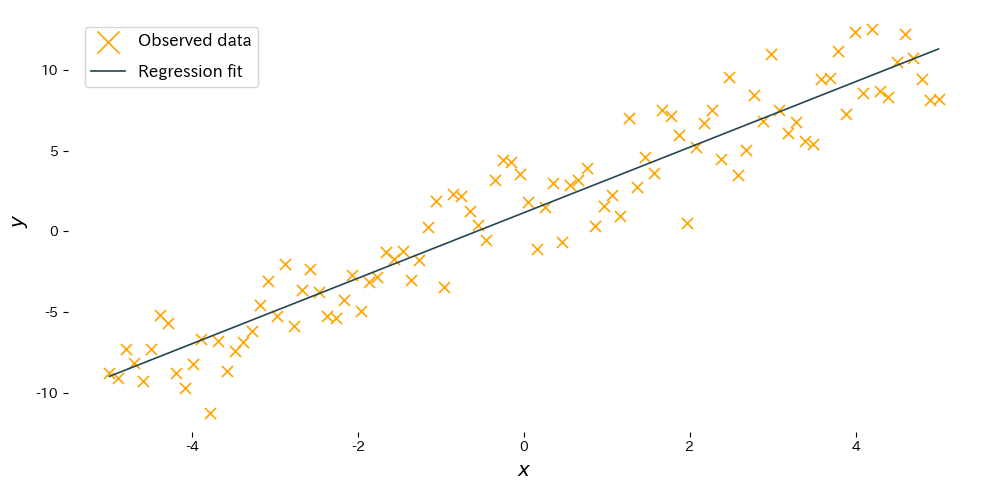

Πειράματα σε Python #

Ο παρακάτω κώδικας προσαρμόζει μια απλή ευθεία παλινδρόμησης με το scikit-learn και σχεδιάζει το αποτέλεσμα. Ο κώδικας είναι ίδιος με την ιαπωνική σελίδα, οπότε τα σχήματα ταιριάζουν μεταξύ γλωσσών.

| |

Ανάγνωση των αποτελεσμάτων #

- Κλίση \(w\): δείχνει πόσο αυξάνεται ή μειώνεται η έξοδος όταν η είσοδος αυξάνεται κατά μία μονάδα. Η εκτίμηση πρέπει να είναι κοντά στην πραγματική κλίση.

- Τεταγμένη στην αρχή \(b\): δείχνει την αναμενόμενη έξοδο όταν η είσοδος είναι 0, ρυθμίζοντας την κατακόρυφη θέση της ευθείας.

- Η τυποποίηση των χαρακτηριστικών με

StandardScalerσταθεροποιεί τη μάθηση όταν οι είσοδοι διαφέρουν σε κλίμακα.

Αναφορές #

- Draper, N. R., & Smith, H. (1998). Applied Regression Analysis (3rd ed.). John Wiley & Sons.

- Hastie, T., Tibshirani, R., & Friedman, J. (2009). The Elements of Statistical Learning. Springer.