2.3.2

Δέντρο Απόφασης (Παλινδρομητής)

- Τα δέντρα παλινδρόμησης προσεγγίζουν μη γραμμικές σχέσεις διαχωρίζοντας αναδρομικά τον χώρο χαρακτηριστικών μέχρι κάθε φύλλο να μπορεί να αναπαρασταθεί από μία μόνο σταθερά.

- Οι διαχωρισμοί ελαχιστοποιούν το μέσο τετραγωνικό σφάλμα (MSE) των αριστερών και δεξιών παιδιών· η μείωση του MSE καθορίζει αν μια ερώτηση είναι χρήσιμη.

- Υπερπαράμετροι όπως

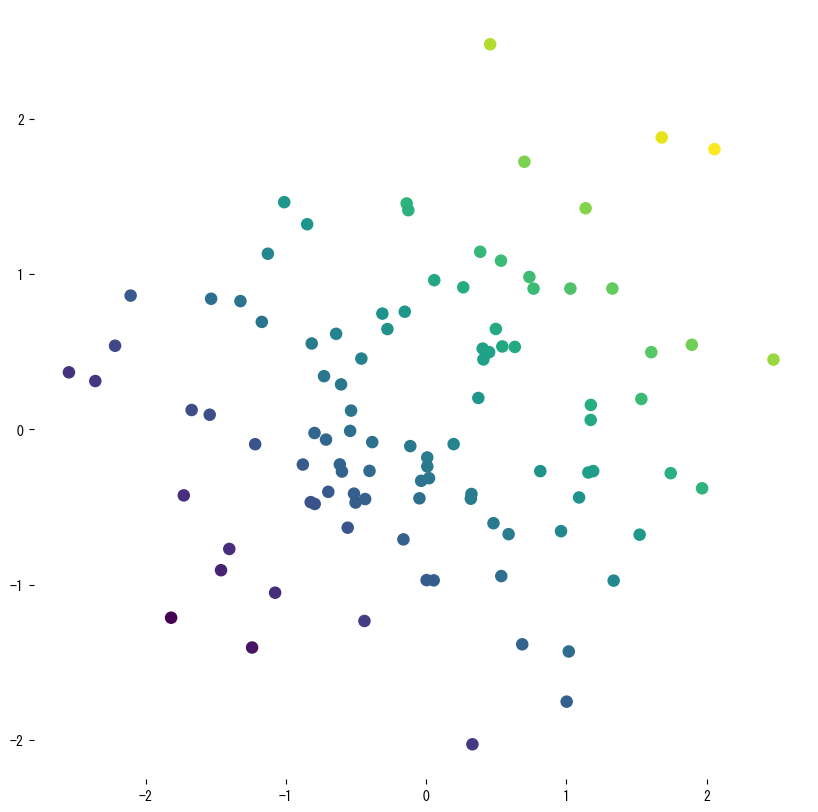

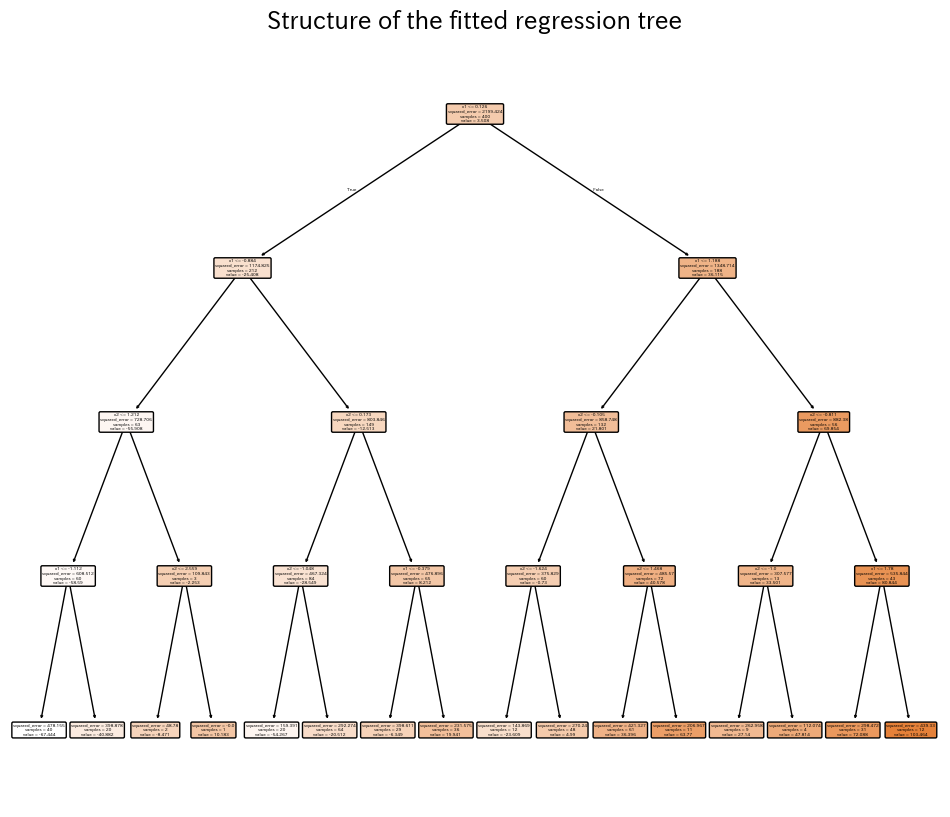

max_depth,min_samples_leafκαιccp_alphaεξισορροπούν την ακρίβεια με την ερμηνευσιμότητα και βοηθούν στην αποφυγή υπερπροσαρμογής. - Οπτικά διαγνωστικά εργαλεία–διαγράμματα διασποράς, χάρτες ισοϋψών και αποδοθέντα δέντρα–διευκολύνουν την εξήγηση ποιες περιοχές μοιράζονται την ίδια πρόβλεψη.

Εισαγωγή #

Αυτή η μέθοδος θα πρέπει να ερμηνεύεται μέσω των υποθέσεών της, των συνθηκών δεδομένων και του τρόπου με τον οποίο οι επιλογές παραμέτρων επηρεάζουν τη γενίκευση.

Αναλυτική Επεξήγηση #

1. Επισκόπηση #

Όπως οι ταξινομητές, τα δέντρα παλινδρόμησης θέτουν απλές ερωτήσεις σχετικά με τα χαρακτηριστικά εισόδου, αλλά ο στόχος είναι συνεχής. Κάθε φύλλο προβλέπει μια σταθερά (τον μέσο όρο των δειγμάτων εκπαίδευσης που κατέληξαν εκεί). Επειδή η συνάρτηση είναι τμηματικά σταθερή, η αύξηση του βάθους αποτυπώνει ολοένα και πιο λεπτομερή δομή, ενώ τα ρηχά δέντρα δίνουν έμφαση σε ομαλές τάσεις.

2. Κριτήριο διαχωρισμού (μείωση διασποράς) #

Για έναν κόμβο (t) που περιέχει (n_t) δείγματα και μέσο στόχο (\bar{y}_t), η ακαθαρσία είναι το MSE του κόμβου:

$$ \mathrm{MSE}(t) = \frac{1}{n_t} \sum_{i \in t} (y_i - \bar{y}_t)^2. $$Ο διαχωρισμός στο (x_j) στο κατώφλι (s) δίνει παιδιά (t_L) και (t_R). Η ποιότητα του διαχωρισμού μετράται από

$$ \Delta = \mathrm{MSE}(t) - \frac{n_L}{n_t} \mathrm{MSE}(t_L) - \frac{n_R}{n_t} \mathrm{MSE}(t_R). $$Επιλέγουμε τον διαχωρισμό με το μεγαλύτερο (\Delta)· όταν κανένας διαχωρισμός δεν δίνει θετικό κέρδος, ο κόμβος γίνεται φύλλο.

3. Παράδειγμα σε Python #

Το πρώτο απόσπασμα κώδικα εκπαιδεύει ένα ρηχό δέντρο σε θορυβώδη δείγματα από μια ημιτονοειδή καμπύλη, ώστε να δούμε την τμηματικά σταθερή φύση της πρόβλεψης. Ένα δεύτερο πείραμα εκπαιδεύει έναν παλινδρομητή δύο χαρακτηριστικών, αξιολογεί τα (R^2), RMSE και MAE, και οπτικοποιεί την εκμαθημένη επιφάνεια καθώς και το τελικό δέντρο.

| |

| |

| |

4. Αναφορές #

- Breiman, L., Friedman, J. H., Olshen, R. A., & Stone, C. J. (1984). Classification and Regression Trees. Wadsworth.

- scikit-learn developers. (2024). Decision Trees. https://scikit-learn.org/stable/modules/tree.html