2.2.2

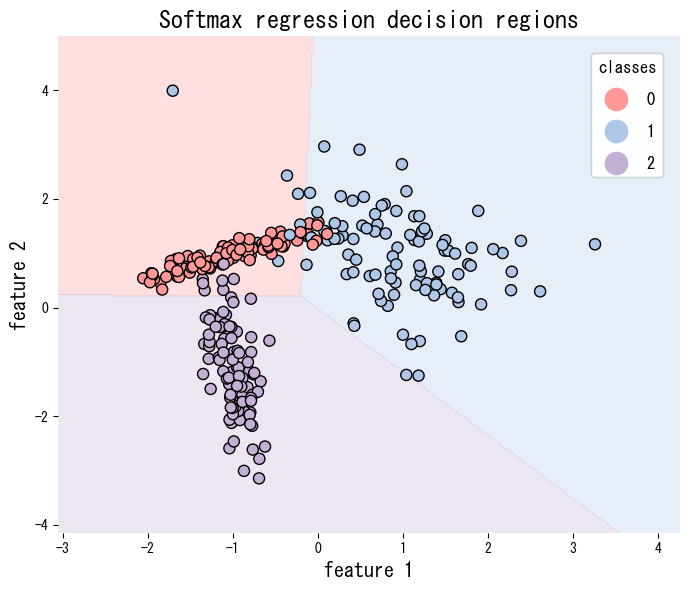

Regressão Softmax

Resumo

- A regressão softmax generaliza a regressão logística para múltiplas classes, produzindo a probabilidade de cada classe simultaneamente.

- As saídas pertencem ao intervalo \([0, 1]\) e somam 1, podendo ser usadas diretamente em limiares de decisão, regras sensíveis ao custo ou pipelines subsequentes.

- O treinamento minimiza a perda de entropia cruzada, corrigindo diretamente as discrepâncias entre as distribuições de probabilidade previstas e reais.

- No scikit-learn,

LogisticRegression(multi_class="multinomial")implementa a regressão softmax e suporta regularização L1/L2.

Intuição #

Este método deve ser interpretado por meio de suas suposições, condições dos dados e como as escolhas de parâmetros afetam a generalização.

Explicação Detalhada #

Formulação Matemática #

Seja \(K\) o número de classes, \(\mathbf{w}_k\) e \(b_k\) os parâmetros para a classe \(k\). Então

$$ P(y = k \mid \mathbf{x}) = \frac{\exp\left(\mathbf{w}_k^\top \mathbf{x} + b_k\right)} {\sum_{j=1}^{K} \exp\left(\mathbf{w}_j^\top \mathbf{x} + b_j\right)}. $$O objetivo é a perda de entropia cruzada

$$ L = - \sum_{i=1}^{n} \sum_{k=1}^{K} \mathbb{1}(y_i = k) \log P(y = k \mid \mathbf{x}_i), $$com regularização opcional dos pesos para evitar sobreajuste.

Experimentos em Python #

O script abaixo aplica a regressão softmax a um conjunto de dados sintético de três classes e visualiza as regiões de decisão. A configuração multi_class="multinomial" ativa a formulação softmax.

| |

Referências #

- Bishop, C. M. (2006). Pattern Recognition and Machine Learning. Springer.

- Murphy, K. P. (2012). Machine Learning: A Probabilistic Perspective. MIT Press.