2.1.11

Mínimos Quadrados Ponderados (WLS)

Resumo

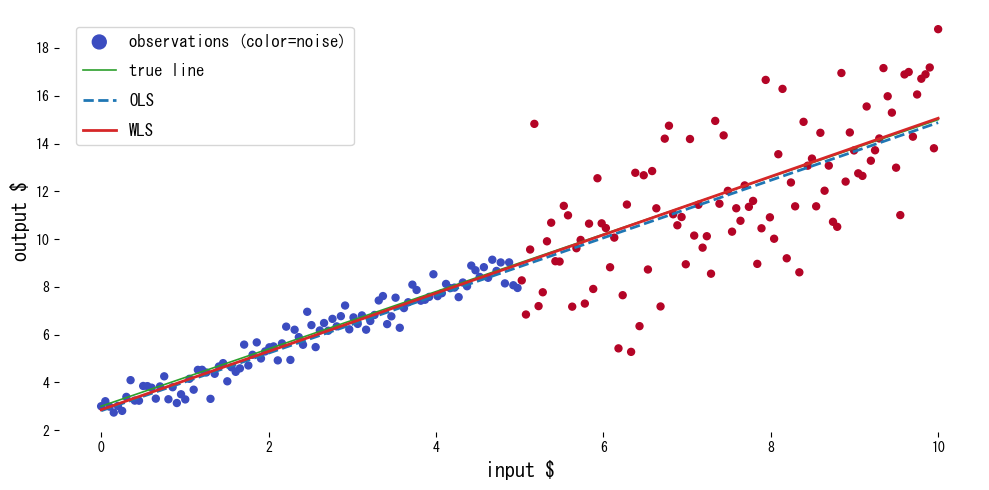

- Os Mínimos Quadrados Ponderados atribuem pesos específicos por observação para que medições confiáveis influenciem mais fortemente a reta ajustada.

- Multiplicar os erros quadrados por pesos reduz a importância de observações com alta variância e mantém a estimativa próxima dos dados confiáveis.

- Você pode executar WLS com a

LinearRegressiondo scikit-learn fornecendosample_weight. - Os pesos podem vir de variâncias conhecidas, diagnósticos de resíduos ou conhecimento de domínio; o design cuidadoso é crucial.

Intuição #

Este método deve ser interpretado através de suas suposições, condições dos dados e como as escolhas de parâmetros afetam a generalização.

Explicação Detalhada #

Formulação Matemática #

Com pesos positivos \(w_i\), minimize

$$ L(\boldsymbol\beta, b) = \sum_{i=1}^{n} w_i \left(y_i - (\boldsymbol\beta^\top \mathbf{x}_i + b)\right)^2. $$A escolha ótima \(w_i \propto 1/\sigma_i^2\) (variância inversa) dá mais influência às observações precisas.

Experimentos em Python #

Comparamos OLS e WLS em dados cujo nível de ruído difere entre regiões.

| |

Interpretação dos resultados #

- A ponderação direciona o ajuste para a região de baixo ruído, produzindo estimativas próximas da reta verdadeira.

- O OLS é distorcido pela região ruidosa e subestima a inclinação.

- O desempenho depende da escolha de pesos apropriados; diagnósticos e intuição de domínio são importantes.

Referências #

- Carroll, R. J., & Ruppert, D. (1988). Transformation and Weighting in Regression. Chapman & Hall.

- Seber, G. A. F., & Lee, A. J. (2012). Linear Regression Analysis (2nd ed.). Wiley.