2.9.2

การตรวจจับความผิดปกติ ②

สรุป

- สรุปเป้าหมาย สมมติฐาน และเงื่อนไขที่เหมาะสมของวิธีนี้.

- ตรวจสอบว่ากฎการอัปเดตหรือเกณฑ์การแบ่งส่งผลต่อพฤติกรรมโมเดลอย่างไร.

- ใช้ตัวอย่างโค้ดเพื่อกำหนดแนวทางปรับพารามิเตอร์อย่างเป็นรูปธรรม.

สัญชาตญาณ #

การตรวจจับความผิดปกติ ② ควรเข้าใจผ่านสมมติฐาน กลไกการปรับปรุงโมเดล และรูปแบบความผิดพลาดบนข้อมูลจริง เพื่อให้เลือกโมเดลและปรับพารามิเตอร์ได้อย่างเหมาะสม.

คำอธิบายโดยละเอียด #

1. เตรียมข้อมูลทดลอง #

เพิ่มคอลัมน์ใหม่ให้ข้อมูลเซนเซอร์เดิม เพื่อให้เป็นข้อมูล 2 มิติ

| |

| |

2. แนวคิดของการตรวจจับแบบหลายมิติ #

- มิติเดียว จะดู outlier ของฟีเจอร์นั้น ๆ

- หลายมิติ จะดูจุดที่ “ความสัมพันธ์ระหว่างฟีเจอร์” ผิดปกติ

ตัวอย่าง:

valueและvalue2ดูปกติทีละตัว → ปกติ- แต่ความสัมพันธ์ระหว่างสองตัวผิดปกติ → ผิดปกติ

3. วิธีที่ใช้ในตัวอย่าง #

ทดลอง 3 วิธีหลัก

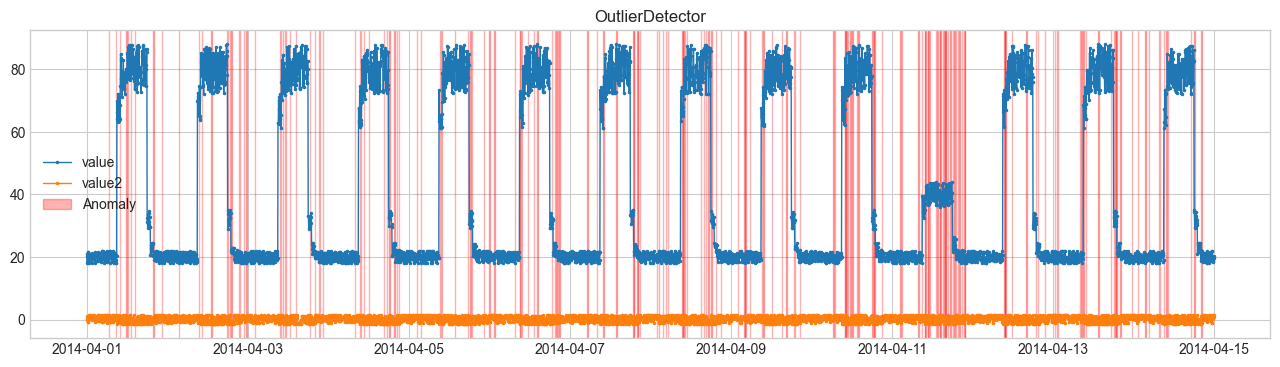

(1) OutlierDetector (LOF) #

ใช้ Local Outlier Factor (LOF)

วัดความหนาแน่นเฉพาะจุดเพื่อบอกว่าเป็น outlier หรือไม่

\(\text{lrd}\) คือ local reachability density

ค่า LOF สูง → จุดนั้น “โดดเดี่ยว” จากเพื่อนบ้าน

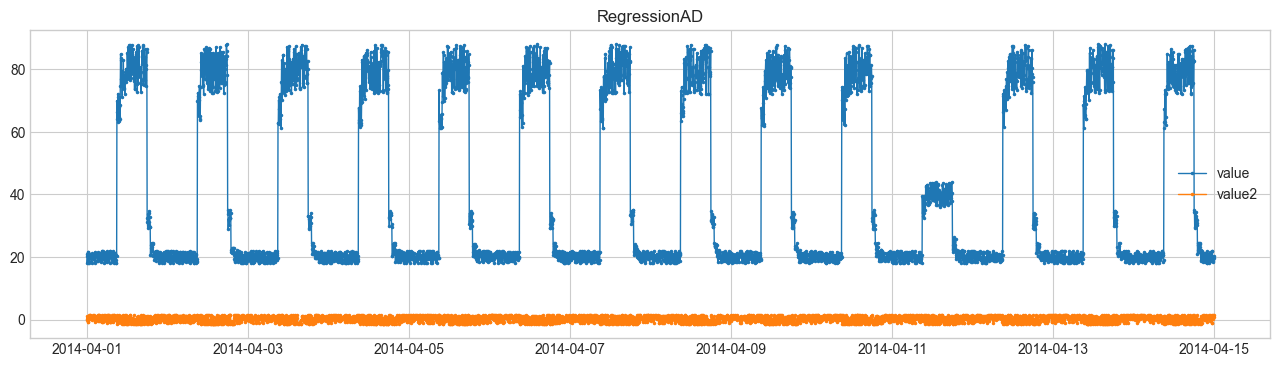

(2) RegressionAD (ความคลาดเคลื่อนจากรีเกรสชัน) #

ทำนายฟีเจอร์หนึ่ง (เช่น value2) จากฟีเจอร์อื่น แล้วใช้ความคลาดเคลื่อนเป็นสัญญาณผิดปกติ

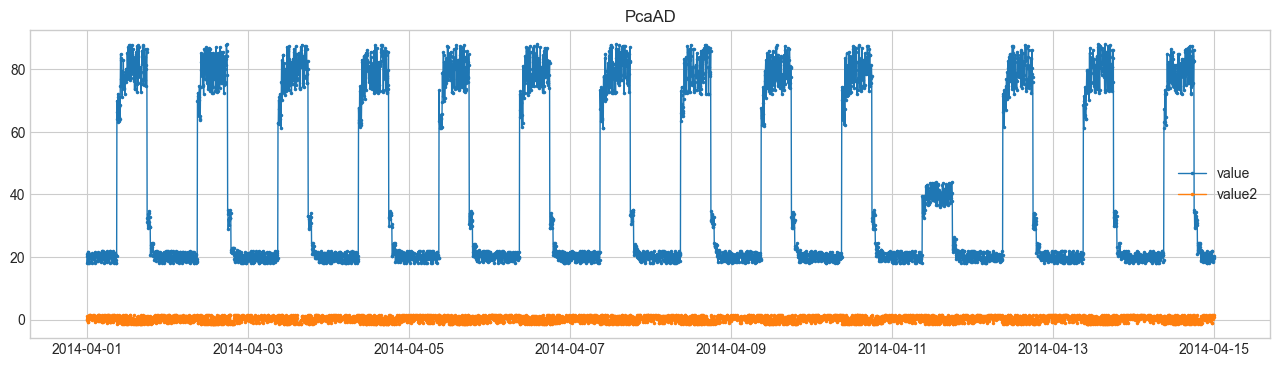

(3) PcaAD (PCA) #

ลดมิติด้วย PCA แล้วมองจุดที่ไม่สามารถอธิบายในมิติลดรูปได้

- แยกองค์ประกอบหลักของเมทริกซ์ \(X\)

- ดูค่าคลาดเคลื่อนหลังการสร้างกลับ $$ \| X - X_{\text{reconstructed}} \| > \text{threshold} $$

4. โค้ดทดลอง #

| |

5. การแสดงผล #